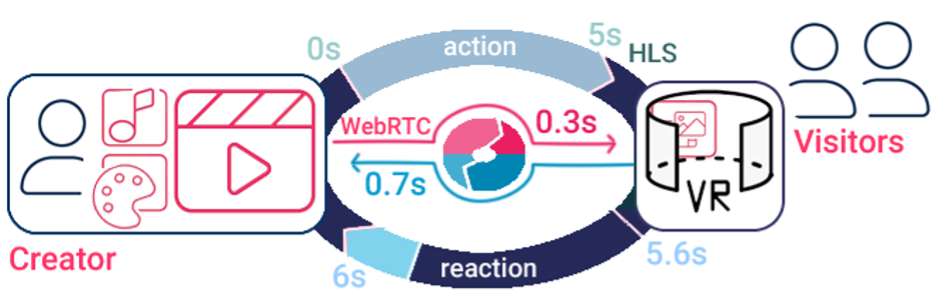

Der Nutzen des XRevent Broadcasters liegt vor allem in der Reduktion von Streaminglatenzen und bietet zusätzlich eine Feedbackmöglichkeit für die Performer*innen aus dem realen Raum. Sie/er kann also im realen Raum performen und sieht fast zeitgleich wie ihre/seine Performance im virtuellen Raum beim Publikum ankommt und kann darauf reagieren. Außerdem werden so Fragerunden zwischen realer und virtueller Konferenz möglich.

Um einen im Live-Show relevanten Kommunikationskreislauf zwischen Performer und Zuschauer herzustellen und aufrecht zu erhalten, sind bereits 2 Sekunden zu viel, weshalb wir und für WebRTC entschieden.

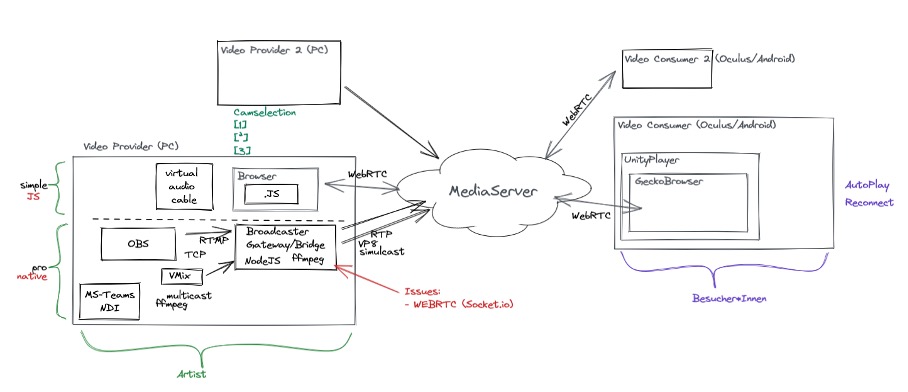

Der typische Anwendungsfall für den XRevent-Broadcaster bildet sich in etwa wie folgt auf das verteilte System ab. Ein Künstler*innen erzeugt ein Videobild (meist mit Audio), welches von mehreren Konsumenten auf einer Quest, Quest2 oder Pico4 empfangen wird. Damit die Performer*innen die Reaktionen abschätzen können, erhalten sie ein Stream aus der VR oder direkt zurück.

Um konzentriert am Kern des XRevent Broadcaster arbeiten zu können und in-vivo Probleme schnell zu erkennen, wurden zwei Use Case Szenarien entwickelt. Das (1) CineDemo und (2) das LiveSet Demo. Ziel des CineDemo war es über mehrere Stunden eine unterbrechungsfreie VideoPerformance testen zu können. So wurden z.B. bei MultiUser Videoabenden getestet, inwiefern ein Realszenario mit verschiedenen Bandbreiten und Verbindungsabbrüchen für eine gemeinsame Soziale VR Group Experience taugt. Ziel des LiveSet Demos war die Demonstration der sehr geringen Latenz in einem Live VJ Set in dem mit einem Sequencer Ton und Bild Live präsentiert wird.

XRevent CineDemo: https://github.com/xrchisense/xrevent-broadcaster-cinemaDemo

LiveSet Demo: https://github.com/xrchisense/xrevent-broadcaster-liveSetDemo